© grzegorz kula dreamstime.com

Technologie |

To ważne. Qualcomm wierzy, że w niedługim czasie zmieni się to, jak mierzymy jakość AI. Wkrótce miernikiem jakości (benchmarkiem) stanie się ilość inteligencji jaką generuje dane rozwiązanie, w stosunku do liczby dżuli, jaką wymaga by móc efektywnie pracować. Takie rozumowanie wynikać ma z dwóch zasadniczych elementów:

To ważne. Qualcomm wierzy, że w niedługim czasie zmieni się to, jak mierzymy jakość AI. Wkrótce miernikiem jakości (benchmarkiem) stanie się ilość inteligencji jaką generuje dane rozwiązanie, w stosunku do liczby dżuli, jaką wymaga by móc efektywnie pracować. Takie rozumowanie wynikać ma z dwóch zasadniczych elementów:  Co więc można poprawić? CNN cierpi na kilka bolączek, rozumianych jako „zły i brzydki”. Można tu wspomnieć choćby o ogromnym apetycie na zasoby pamięciowe, moc obliczeniową oraz energię. Sieć jest też mało odporna na duże zmiany, czego przykładem może być obrót psa do góry nogami. CNN nauczone rozpoznawania psa w normalnej pozie nie rozpozna go w tak niecodziennym ustawieniu. Sieci takie nie są więc niezawodne i łatwo je oszukać.

Qualcomm pragnie pokonać te problemy i ograniczenia, tworząc nowe techniki. Obiecującym w tym zakresie wydaje się być algorytm „Bayesian Deep Learning”.

Szum bywa dobry

Technika ta jest metodą stochastyczną. Polega ona na dodawaniu szumu lub wartości losowych do wag sieci neuronowej, które następnie propagują do dalszych węzłów (neuronów) aktywacyjnych. Szum ten to dobra rzecz. Jego dodanie zostało zainspirowane pracą ludzkiego mózgu, do którego również dociera dużo niepotrzebnych informacji, lecz nauczyliśmy się je umiejętnie odsiewać.

Dodatkową zaletą nauczania Bayesiana jest kompresja i kwantyzacja, która zmniejsza złożoność modelu sieci neuronowej. Kwantyzacja redukuje długość bitową parametrów (np. poprzez użycie czterech bitów zamiast ośmiu) i kompresuje liczbę aktywacji w modelu. To z kolei skutkuje poprawą efektywności energetycznej.

Nauczanie Bayesian nie jest tylko teorią. W ośrodku badawczym Qualcomm udało się zaaplikować ten system w praktyce. Zastosowano go do sieci rozpoznającej obrazy i porównano z ResNet-18. Po doprowadzeniu sieci do takiej samej funkcjonalności i dokładności w rozpoznawaniu obrazów i odpowiednich optymalizacjach zauważono, że sieć oparta na modelu Bayesiana cechuje się 3-krotnie lepszą kompresją, przy zachowaniu takiej samej dokładności jak klasyczny model ResNet.

A co dalej?

Prace będą trwały. Na celowniku, oprócz algorytmów, są także kwestie związane z samym sprzętem i jego optymalizacją pod potrzeby AI i sieci neuronowych klasy DNN. Badane i obserwowane będzie zachowanie funkcji AI w rzeczywistych warunkach na rzeczywistych maszynach i tworzone będą plany optymalizacyjne architektury sprzętowej, wliczając w to pamięć. Celem jest usunięcie wąskich gardeł celem poprawy wydajności. Pomóc w tym mogą właśnie takie algorytmy jak nauczanie Bayesian.

© Qualcomm

Co więc można poprawić? CNN cierpi na kilka bolączek, rozumianych jako „zły i brzydki”. Można tu wspomnieć choćby o ogromnym apetycie na zasoby pamięciowe, moc obliczeniową oraz energię. Sieć jest też mało odporna na duże zmiany, czego przykładem może być obrót psa do góry nogami. CNN nauczone rozpoznawania psa w normalnej pozie nie rozpozna go w tak niecodziennym ustawieniu. Sieci takie nie są więc niezawodne i łatwo je oszukać.

Qualcomm pragnie pokonać te problemy i ograniczenia, tworząc nowe techniki. Obiecującym w tym zakresie wydaje się być algorytm „Bayesian Deep Learning”.

Szum bywa dobry

Technika ta jest metodą stochastyczną. Polega ona na dodawaniu szumu lub wartości losowych do wag sieci neuronowej, które następnie propagują do dalszych węzłów (neuronów) aktywacyjnych. Szum ten to dobra rzecz. Jego dodanie zostało zainspirowane pracą ludzkiego mózgu, do którego również dociera dużo niepotrzebnych informacji, lecz nauczyliśmy się je umiejętnie odsiewać.

Dodatkową zaletą nauczania Bayesiana jest kompresja i kwantyzacja, która zmniejsza złożoność modelu sieci neuronowej. Kwantyzacja redukuje długość bitową parametrów (np. poprzez użycie czterech bitów zamiast ośmiu) i kompresuje liczbę aktywacji w modelu. To z kolei skutkuje poprawą efektywności energetycznej.

Nauczanie Bayesian nie jest tylko teorią. W ośrodku badawczym Qualcomm udało się zaaplikować ten system w praktyce. Zastosowano go do sieci rozpoznającej obrazy i porównano z ResNet-18. Po doprowadzeniu sieci do takiej samej funkcjonalności i dokładności w rozpoznawaniu obrazów i odpowiednich optymalizacjach zauważono, że sieć oparta na modelu Bayesiana cechuje się 3-krotnie lepszą kompresją, przy zachowaniu takiej samej dokładności jak klasyczny model ResNet.

A co dalej?

Prace będą trwały. Na celowniku, oprócz algorytmów, są także kwestie związane z samym sprzętem i jego optymalizacją pod potrzeby AI i sieci neuronowych klasy DNN. Badane i obserwowane będzie zachowanie funkcji AI w rzeczywistych warunkach na rzeczywistych maszynach i tworzone będą plany optymalizacyjne architektury sprzętowej, wliczając w to pamięć. Celem jest usunięcie wąskich gardeł celem poprawy wydajności. Pomóc w tym mogą właśnie takie algorytmy jak nauczanie Bayesian.

© Qualcomm

Qualcomm o tym, jak algorytmika wpływa na efektywność energetyczną AI

Sieci neuronowe są coraz skuteczniejsze, szybsze i dokładniejsze, dzięki czemu sprawdzają się w coraz liczniejszych dziedzinach. Jednak sieci CNN, na których opiera się DNN, cierpią na zbytnią ‘zasobożerność’. Nowe algorytmy i technika uczenia Qualcomma zdaje się to przezwyciężać.

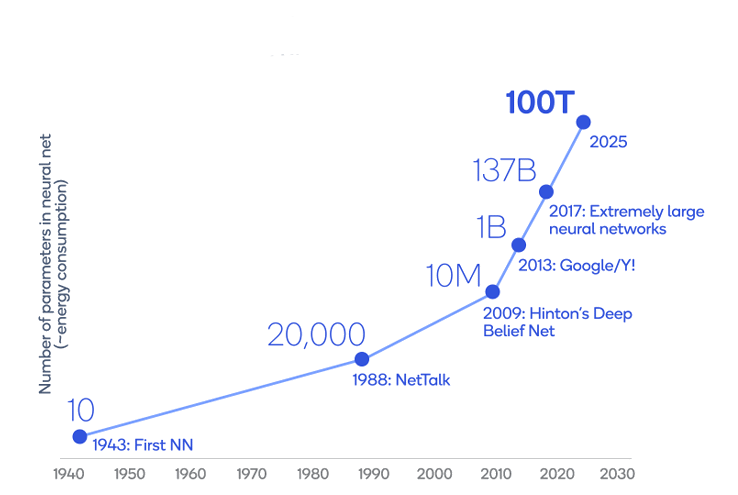

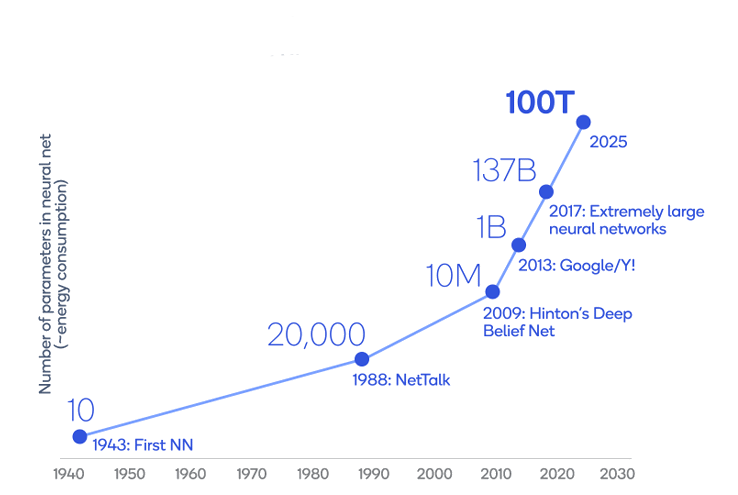

Projektujesz elektronikę? Zarezerwuj 4 października 2018 roku na największą w Polsce konferencję dedykowaną projektantom, Evertiq Expo Kraków 2018. Przeszło 60 producentów i dystrybutorów komponentów do Twojej dyspozycji, ciekawe wykłady i świetna, twórcza atmosfera. Jesteś zaproszony, wstęp wolny: kliknij po szczegóły.Tryliony połączonych ze sobą urządzeń, a w nich AI, które wspomaga nas w codziennej pracy w wielu dziedzinach – to wizja i obietnica Qualcomm Technologies, jaką niedawno firma złożyła swoim klientom i partnerom. Z tego też powodu, wysiłki Qualcomm są kierowane w stronę rozwoju technologicznego właśnie w zakresie AI i sieci neuronowych. Aby AI mogło skutecznie działać w wielu połączonych ze sobą urządzeniach, często niewielkich i mobilnych, koniecznym jest poprawienie efektywności energetycznej przetwarzania w układach, strukturach i sieciach AI. W ośrodkach badawczych Qualcomm duży nacisk kładzie się właśnie na ten element. Postaramy się Państwu pokazać przykład tych prac rozwojowych, jednocześnie pokazując, jak wielką rolę odgrywają w tym miejscu algorytmy AI. Inteligencja/dżul AI jest napędzane przez silny rozwój głębokich sieci neuronowych (DNN - „deep neutral networks”). Jednakże zauważalna jest też znacząca poprawa dokładności w wykładniczym wzrośnie zużycia energii. Zgodnie z postępującym trendem, w 2025 roku możemy liczyć się z liczbą parametrów wagowych sięgającą 100 trylionów. Jest to liczba porównywalna z liczbą synaps w ludzkim mózgu. Mózg ten daje nam też dużą nadzieję, że jesteśmy w stanie jeszcze wiele poprawić. Wszakże ludzki mózg jest nawet 100-krotnie bardziej wydajny (w kwestii zużywania energii), niż najlepsze nawet obecne rozwiązania sprzętowe i krzemowe.© Evertiq

To ważne. Qualcomm wierzy, że w niedługim czasie zmieni się to, jak mierzymy jakość AI. Wkrótce miernikiem jakości (benchmarkiem) stanie się ilość inteligencji jaką generuje dane rozwiązanie, w stosunku do liczby dżuli, jaką wymaga by móc efektywnie pracować. Takie rozumowanie wynikać ma z dwóch zasadniczych elementów:

To ważne. Qualcomm wierzy, że w niedługim czasie zmieni się to, jak mierzymy jakość AI. Wkrótce miernikiem jakości (benchmarkiem) stanie się ilość inteligencji jaką generuje dane rozwiązanie, w stosunku do liczby dżuli, jaką wymaga by móc efektywnie pracować. Takie rozumowanie wynikać ma z dwóch zasadniczych elementów: - Kwestie ekonomiczne – ogólna efektywność ekonomiczna wymaga bowiem, by AI była energooszczędna. Istotną rzeczą jest bowiem to, by wartość wytworzona przez AI przekraczała koszty jej pracy.

- Mobilność – możliwość uruchamiania funkcji i modułów AI w niewielkich, lekkich, mobilnych urządzeniach wymaga, by rozwiązania AI nie zużywały wiele energii. Funkcje AI trafiać będą też np. do smartfonów, a nikt nie chciałby, by przez to urządzenie pracowało krócej. Dotyczy to też wielu innych dziedzin i aplikacji, w szczególności robotyki: dronów, robotów produkcyjnych czy też samochodów autonomicznych (w tym zyskujących na popularności i znaczeniu pojazdów elektrycznych). Ważnym jest także wpasowanie się w zyskującą na popularności ideę „always-on”.

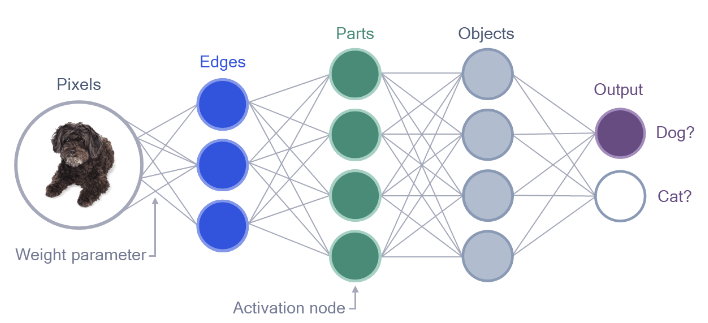

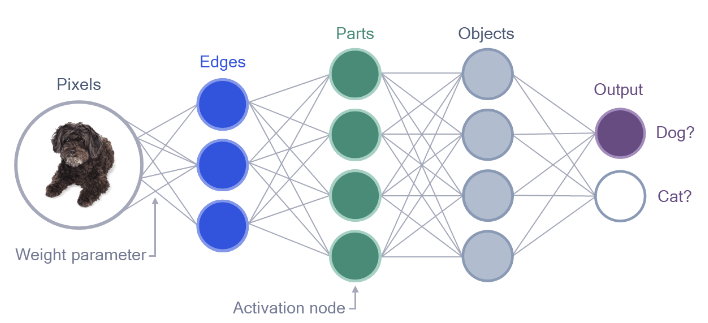

Co więc można poprawić? CNN cierpi na kilka bolączek, rozumianych jako „zły i brzydki”. Można tu wspomnieć choćby o ogromnym apetycie na zasoby pamięciowe, moc obliczeniową oraz energię. Sieć jest też mało odporna na duże zmiany, czego przykładem może być obrót psa do góry nogami. CNN nauczone rozpoznawania psa w normalnej pozie nie rozpozna go w tak niecodziennym ustawieniu. Sieci takie nie są więc niezawodne i łatwo je oszukać.

Qualcomm pragnie pokonać te problemy i ograniczenia, tworząc nowe techniki. Obiecującym w tym zakresie wydaje się być algorytm „Bayesian Deep Learning”.

Szum bywa dobry

Technika ta jest metodą stochastyczną. Polega ona na dodawaniu szumu lub wartości losowych do wag sieci neuronowej, które następnie propagują do dalszych węzłów (neuronów) aktywacyjnych. Szum ten to dobra rzecz. Jego dodanie zostało zainspirowane pracą ludzkiego mózgu, do którego również dociera dużo niepotrzebnych informacji, lecz nauczyliśmy się je umiejętnie odsiewać.

Dodatkową zaletą nauczania Bayesiana jest kompresja i kwantyzacja, która zmniejsza złożoność modelu sieci neuronowej. Kwantyzacja redukuje długość bitową parametrów (np. poprzez użycie czterech bitów zamiast ośmiu) i kompresuje liczbę aktywacji w modelu. To z kolei skutkuje poprawą efektywności energetycznej.

Nauczanie Bayesian nie jest tylko teorią. W ośrodku badawczym Qualcomm udało się zaaplikować ten system w praktyce. Zastosowano go do sieci rozpoznającej obrazy i porównano z ResNet-18. Po doprowadzeniu sieci do takiej samej funkcjonalności i dokładności w rozpoznawaniu obrazów i odpowiednich optymalizacjach zauważono, że sieć oparta na modelu Bayesiana cechuje się 3-krotnie lepszą kompresją, przy zachowaniu takiej samej dokładności jak klasyczny model ResNet.

A co dalej?

Prace będą trwały. Na celowniku, oprócz algorytmów, są także kwestie związane z samym sprzętem i jego optymalizacją pod potrzeby AI i sieci neuronowych klasy DNN. Badane i obserwowane będzie zachowanie funkcji AI w rzeczywistych warunkach na rzeczywistych maszynach i tworzone będą plany optymalizacyjne architektury sprzętowej, wliczając w to pamięć. Celem jest usunięcie wąskich gardeł celem poprawy wydajności. Pomóc w tym mogą właśnie takie algorytmy jak nauczanie Bayesian.

© Qualcomm

Co więc można poprawić? CNN cierpi na kilka bolączek, rozumianych jako „zły i brzydki”. Można tu wspomnieć choćby o ogromnym apetycie na zasoby pamięciowe, moc obliczeniową oraz energię. Sieć jest też mało odporna na duże zmiany, czego przykładem może być obrót psa do góry nogami. CNN nauczone rozpoznawania psa w normalnej pozie nie rozpozna go w tak niecodziennym ustawieniu. Sieci takie nie są więc niezawodne i łatwo je oszukać.

Qualcomm pragnie pokonać te problemy i ograniczenia, tworząc nowe techniki. Obiecującym w tym zakresie wydaje się być algorytm „Bayesian Deep Learning”.

Szum bywa dobry

Technika ta jest metodą stochastyczną. Polega ona na dodawaniu szumu lub wartości losowych do wag sieci neuronowej, które następnie propagują do dalszych węzłów (neuronów) aktywacyjnych. Szum ten to dobra rzecz. Jego dodanie zostało zainspirowane pracą ludzkiego mózgu, do którego również dociera dużo niepotrzebnych informacji, lecz nauczyliśmy się je umiejętnie odsiewać.

Dodatkową zaletą nauczania Bayesiana jest kompresja i kwantyzacja, która zmniejsza złożoność modelu sieci neuronowej. Kwantyzacja redukuje długość bitową parametrów (np. poprzez użycie czterech bitów zamiast ośmiu) i kompresuje liczbę aktywacji w modelu. To z kolei skutkuje poprawą efektywności energetycznej.

Nauczanie Bayesian nie jest tylko teorią. W ośrodku badawczym Qualcomm udało się zaaplikować ten system w praktyce. Zastosowano go do sieci rozpoznającej obrazy i porównano z ResNet-18. Po doprowadzeniu sieci do takiej samej funkcjonalności i dokładności w rozpoznawaniu obrazów i odpowiednich optymalizacjach zauważono, że sieć oparta na modelu Bayesiana cechuje się 3-krotnie lepszą kompresją, przy zachowaniu takiej samej dokładności jak klasyczny model ResNet.

A co dalej?

Prace będą trwały. Na celowniku, oprócz algorytmów, są także kwestie związane z samym sprzętem i jego optymalizacją pod potrzeby AI i sieci neuronowych klasy DNN. Badane i obserwowane będzie zachowanie funkcji AI w rzeczywistych warunkach na rzeczywistych maszynach i tworzone będą plany optymalizacyjne architektury sprzętowej, wliczając w to pamięć. Celem jest usunięcie wąskich gardeł celem poprawy wydajności. Pomóc w tym mogą właśnie takie algorytmy jak nauczanie Bayesian.

© Qualcomm